Künstliche Intelligenz ist ein ungeeigneter Begriff

Dieses Biblionetz-Objekt existiert erst seit Januar 2024.

Es ist deshalb gut möglich, dass viele der eigentlich vorhandenen Vernetzungen zu älteren Biblionetz-Objekten bisher nicht erstellt wurden.

Somit kann es sein, dass diese Seite sehr lückenhaft ist.

Dieses Biblionetz-Objekt existiert erst seit Januar 2024.

Es ist deshalb gut möglich, dass viele der eigentlich vorhandenen Vernetzungen zu älteren Biblionetz-Objekten bisher nicht erstellt wurden.

Somit kann es sein, dass diese Seite sehr lückenhaft ist.

Erklärung als Video

Erklärung als Video

Bemerkungen

Bemerkungen

Künstliche Intelligenz ist ein Marketingbegriff

(lacht). Es gibt keine künstliche Intelligenz. Zumindest bis jetzt noch nicht. Ich bevorzuge den Begriff «maschinelles Lernen», so wie die meisten Leute, die daran forschen.

Künstliche Intelligenz ist ein Marketingbegriff

(lacht). Es gibt keine künstliche Intelligenz. Zumindest bis jetzt noch nicht. Ich bevorzuge den Begriff «maschinelles Lernen», so wie die meisten Leute, die daran forschen.

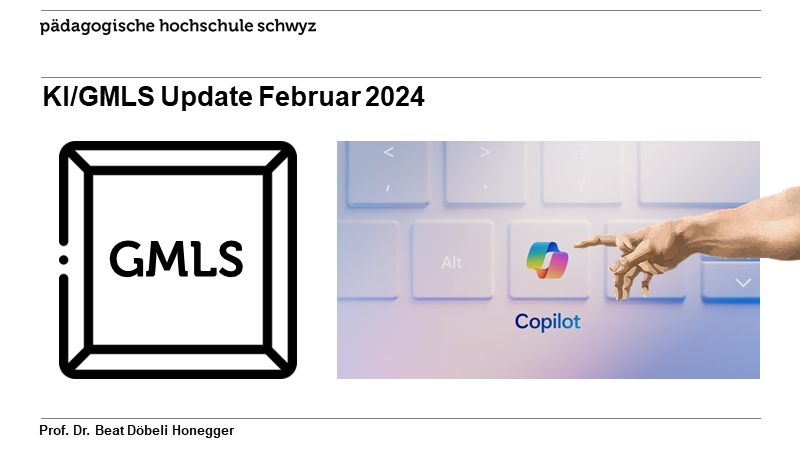

Wir sollten nicht allgemein über KI diskutieren, sondern einzelne Systeme anschauen. Ich gehe doch auch nicht auf eine Baustelle und nenne alles vom Nagel über die Zange bis zum Kran »künstliche Kraft«.

Zunächst mag ich den Begriff »künstliche

Intelligenz« gar nicht. Er wird so inflationär gebraucht.

Letztens hat jemand auf einer Konferenz

seinen Taschenrechner hochgehalten und gesagt,

da sei künstliche Intelligenz drin. Meine Güte! Insofern

bedeutet das Wort nichts. Rein gar nichts!

Zunächst mag ich den Begriff »künstliche

Intelligenz« gar nicht. Er wird so inflationär gebraucht.

Letztens hat jemand auf einer Konferenz

seinen Taschenrechner hochgehalten und gesagt,

da sei künstliche Intelligenz drin. Meine Güte! Insofern

bedeutet das Wort nichts. Rein gar nichts! Indeed, some elements of the computer science community have

recently begun to deliberately distance themselves from the term ‘AI’ and revert to using

labels that better describe the types of machine learning and algorithmic developments

that underpin their work (see Jordon in Pretz, 2021). Elsewhere, policymakers and

industry actors are also beginning to turn to alternate terms, such as ‘automated

decision making’ and ‘algorithmic forecasting.’ Such linguistic turns reinforce Emily

Tucker’s (2022, n.p.) assertation that “whatever the merit of the scientific aspirations

originally encompassed by the term ‘artificial intelligence,’ it [has become] a phrase

that now functions in the vernacular primarily to obfuscate, alienate and glamorize.”

Indeed, some elements of the computer science community have

recently begun to deliberately distance themselves from the term ‘AI’ and revert to using

labels that better describe the types of machine learning and algorithmic developments

that underpin their work (see Jordon in Pretz, 2021). Elsewhere, policymakers and

industry actors are also beginning to turn to alternate terms, such as ‘automated

decision making’ and ‘algorithmic forecasting.’ Such linguistic turns reinforce Emily

Tucker’s (2022, n.p.) assertation that “whatever the merit of the scientific aspirations

originally encompassed by the term ‘artificial intelligence,’ it [has become] a phrase

that now functions in the vernacular primarily to obfuscate, alienate and glamorize.”Um die schwammige Verwendung von künstlicher Intelligenz im gesellschaftlichen Diskurs zu charakterisieren, schlage ich den Begriff der Zeitgeist-KI vor. In dem Zusammenhang kann der Begriff KI dann von Big Data und Statistik über Software, IT, Digitalisierung, Algorithmen, Roboter, Apps und IKT bis hin zum Internet in etwa alles bedeuten. Auch im politischen Diskurs wird pauschal von „künstlicher Intelligenz“ gesprochen, egal, ob es um selbstfahrende Autos, Roboterhunde, automatisierte Entscheidungssysteme, Klimamodelle, automatisierte Arbeitsmarktvermittlungssysteme, Tischreservierungssysteme oder smarte Verkehrsleitsysteme geht; beizeiten werden auch traditionelle Informatikprodukte mit dem Label versehen. Alles ist „KI“, obwohl in alledem wenig bis keine künstliche Intelligenz steckt. In einem aktuellen Bericht zum Stand von KI in der öffentlichen Verwaltung heißt es etwa, „dass oftmals Projekte als KI-basiert bezeichnet würden, jedoch de facto konventionelle IKT-Anwendungen nutzen“. Aber auch in Wissenschaft und Wirtschaft ist jenes schwammige Verständnis anzutreffen. Um eine reflektierte gesellschaftliche Auseinandersetzung mit künstlicher Intelligenz zu ermöglichen, muss dieses Verständnis expliziert, mithin aufgelöst werden.

Instead of using the terms “Artificial intelligence, “AI,” and “machine learning,” the Privacy Center will:

- Be as specific as possible about what the technology in question is and how it works. For example, instead of saying “face recognition uses artificial intelligence,” we might say something like “tech companies use massive data sets to train algorithms to match images of human faces.” Where a complete explanation is disruptive to our larger argument, or beyond our expertise, we will point readers to external sources.

- Identify any obstacles to our own understanding of a technology that result from failures of corporate or government transparency. For example, instead of saying “employers are using AI to analyze workers’ emotions” we might say “employers are using software advertised as having the ability to label workers’ emotions based on images of them from photographs and video. We don’t know how the labeling process works because the companies that sell these products claim that information as a trade secret.”

- Name the corporations responsible for creating and spreading the technological product. For example, instead of saying “states use AI to verify the identities of people applying for unemployment benefits,” we might say “states are contracting with a company called ID.me, which uses Amazon Rekognition, a face matching algorithm, to verify the identities of people applying for unemployment benefits.”

- Attribute agency to the human actors building and using the technology, never to the technology itself. This needn’t always require excessive verbiage. For example, we might substitute “machine training,” which sounds like something a person does with a machine, for “machine learning” which sounds like a computer doing something on its own.

We don’t yet know exactly what will happen to our thinking and writing without these crutches, but finding out is part of the point.

2 Vorträge von Beat mit Bezug

2 Vorträge von Beat mit Bezug

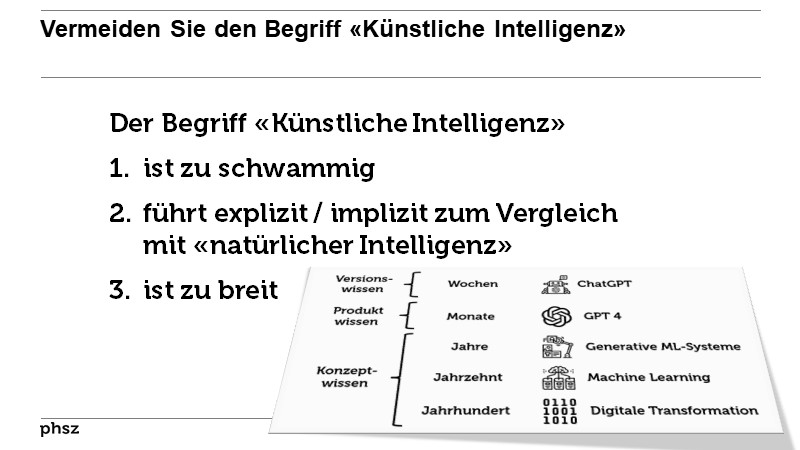

- Wenn ChatGPT in der Lehrer:innenbildung mitredet

(Video des Referats)

Tag der Lehre der PHZH, 01.02.2024

- Antworten auf Knopfdruck?

Mitarbeitendenklausur der PHSZ, 19.02.2024

Zitationsgraph

Zitationsgraph

8 Erwähnungen

8 Erwähnungen

- Stop Calling Everything AI, Machine-Learning Pioneer Says (Kathy Pretz) (2021)

- Artifice and Intelligence (Emily Tucker) (2022)

- Können wir künstlicher Intelligenz vertrauen, Frau Zweig? (Katharina A. Zweig, Rudi Novotny, Stefan Schmitt) (2023)

- »Etwas größenwahnsinnig« (Jaron Lanier, Götz Hamann, Jakob von Lindern) (2023)

- On the Limits of Artificial Intelligence (AI) in Education (Neil Selwyn) (2024)

- AI in education is a public problem (Ben Williamson) (2024)

- Intelligenza: artificiale o meccanica, questo è il problema (Enrico Nardelli) (2024)

- Zwischen Macht und Mythos - Eine kritische Einordnung aktueller KI-Narrative (Rainer Rehak) (2024)

Biblionetz-History

Biblionetz-History